Building a more helpful Google for everyone.

Google 总是有办法,把最前沿的技术用最简单实用的方式普及给覆盖面最广的移动端用户。而每一年的 Google I/O 就是展现这些前沿技术和理念的中心舞台。今年也没有例外。虽然对照往年略显平淡,但和前后夹击的 F8 和 Build 相比,这场盛会仍让我们相信,科技公司只分两类:Google 和 Google 之外的其他公司。

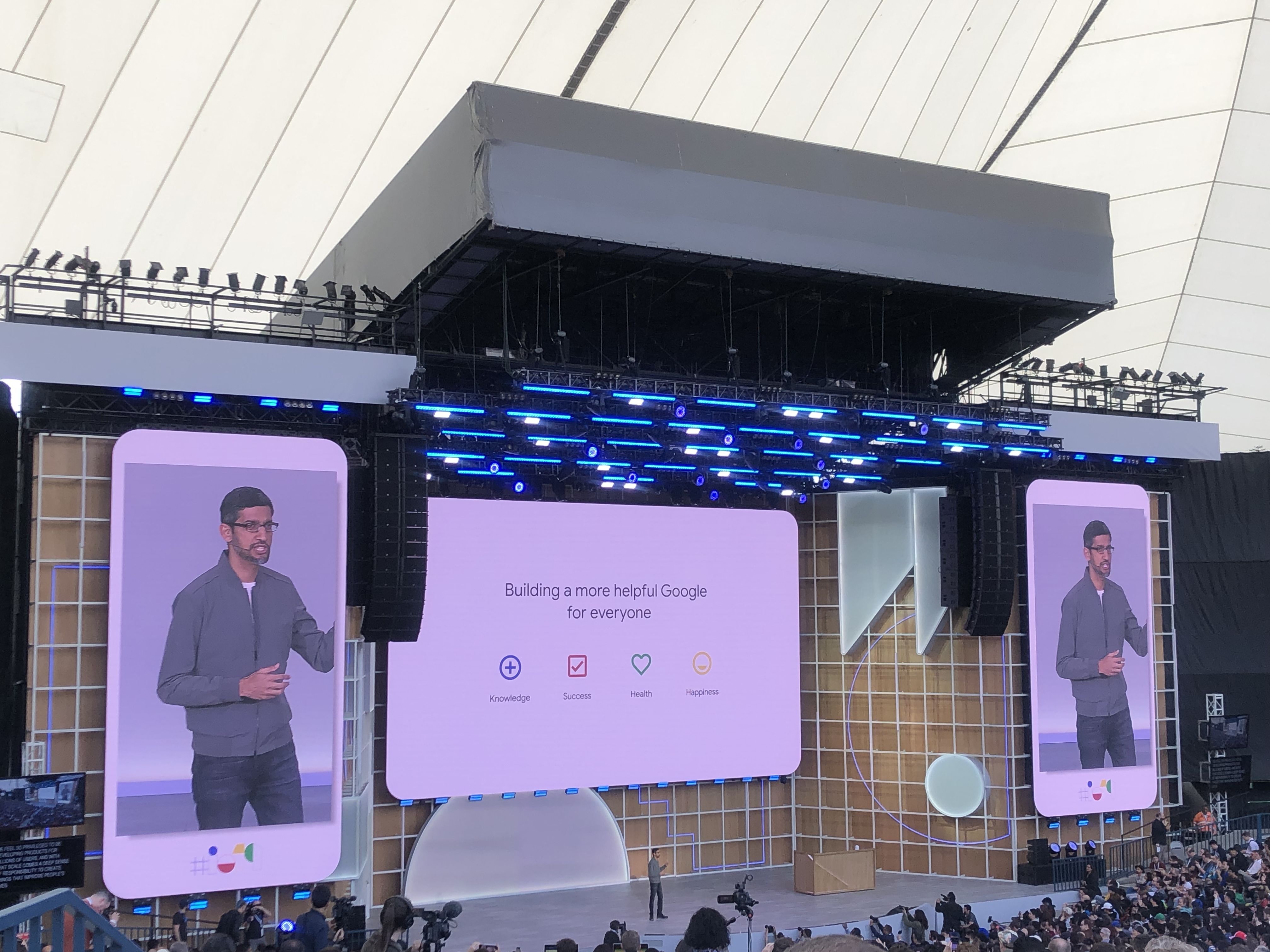

「我们的使命是梳理全世界的信息,并让全世界的人们都能接触并使用它们。」一开场,CEO 桑达尔·皮查伊就聊起了 Google 21 年来从没改变的公司使命。但 Google 实现使命的方式却变了,用皮查伊的话说,他们曾经是一家帮助用户找到答案的公司,但现在,他们正在成为一家帮用户把事情给办了的公司。

Google I/O 现场 | 极客公园

从信息聚合搜索到人工智能的应用,Google 业务的方向变了,但没变的是 Google 对自己的定位和愿景:一家无论对任何人而言都有帮助的公司。

想法很简单,做法却很酷。正因为 Google 始终关注着普通用户最日常的需求,所以每年五月的这场开发者大会也总是能引来很多普通用户的关注。比起一场专业的开发者大会,Google I/O 更像是一次全世界的极客狂欢,这也是为什么每年极客公园都要去山景城的现场参加 I/O 大会的原因之一。

在今年的 Google I/O 上,Google 不负众望地发布了包括手机、音箱在内的多款硬件产品,同时惊艳众人的 AI 应用和软件展示也没有缺位,极客公园对发布内容进行了整理报道,现在,就让我们一起来看一看 Google 究竟带来了哪些新产品和黑科技吧。

Google 搜索

去年,Google 在新闻产品 Google News 中推出了「完整报道(Full Coverage)」功能,通过对相关报道的信息聚合,用户可以一次性对新闻事件有一个全面的了解。在今年的 I/O 上,Google 宣布这项功能将整合到 Google 搜索中。

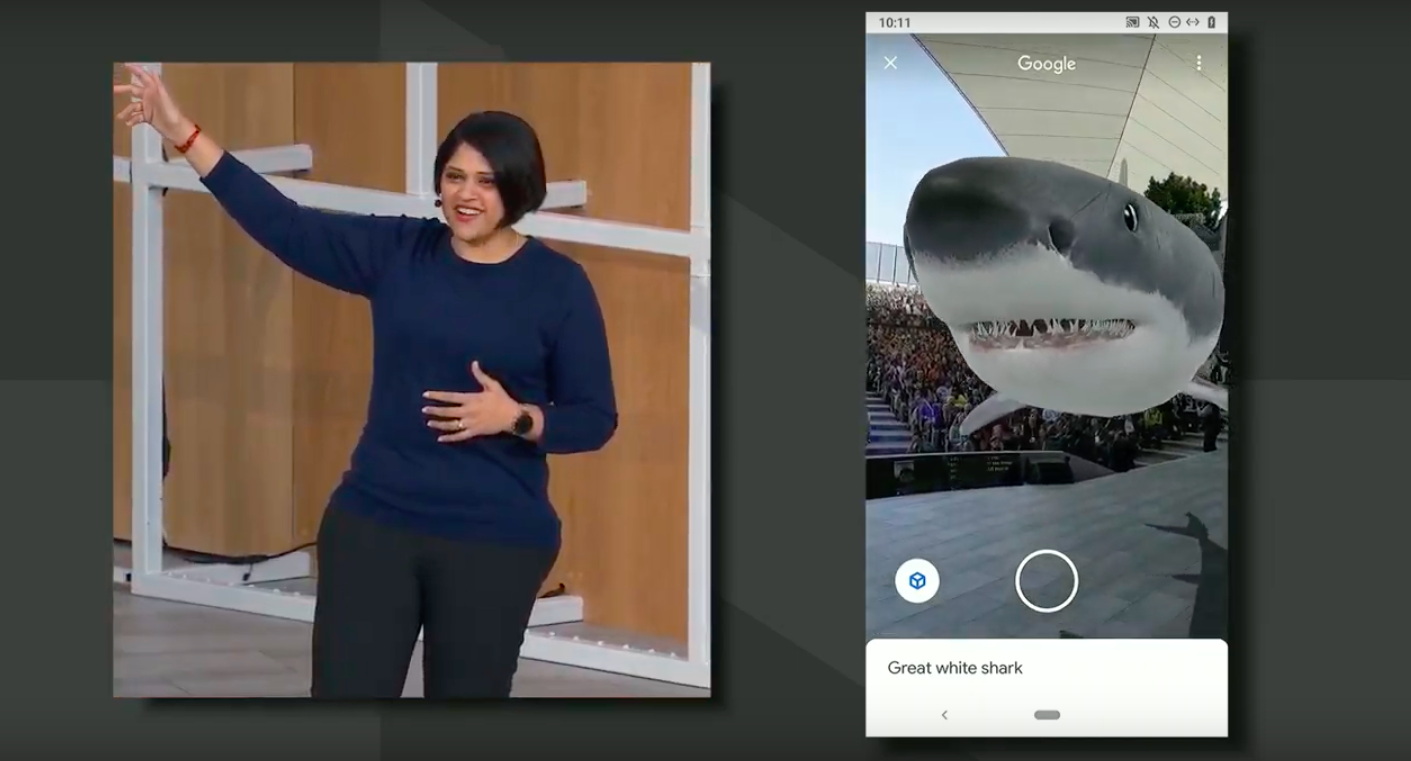

Google 搜索也将在这个月晚些时候加入 AR 功能。用户在 Google 搜索某样东西时,可以查到搜索对象的 3D 可交互格式的「图片」,甚至可以用 AR 增强现实的形式将物体投射到现实世界。例如在现场,当工作人员搜索「大白鲨」,除了得到基本的文字信息和大白鲨 3D 格式的图片以外,还可以将白鲨投射到现实场景中,像下图演示的那样,一只 18 英尺的大白鲨出现在了 Google I/O 的舞台上。

然而,当你想要搜索一件物品却不知道如何形容它时,Google Lens 派上了用场。2017年 Google Lens 面世,基于视觉算法让机器学会「看图说话」,智能识别相机拍摄的物品并提供与之相关的内容。今年,Google Lens 能做的事情更多了。

比如在线下参观点餐时,用摄像头对准文字菜单,Google Lens 能够自动识别出受欢迎的菜品,以及菜品的真实图片,Google Maps上其他用户对于菜品的评价,用餐结束后,用 Google Lens 对准账单,它还能帮你结账,计算出小费。除此以外,用 Google Lens 对准菜谱,屏幕上就会出现菜品制作的视频动图过程,目前这些功能仍需要 Google 与饭店、菜谱出版商合作才能够实现。

除此之外,Google 宣布在轻量级应用 Google Go 中加入原先只有 Google Translate 中能用的相机翻译功能。打开 Google 搜索或者 Google Go 里的相机,对准一段文字,系统能够将文字转成用户想要的语言,甚至还能将翻译后的文字朗读出来。

Android Q

在宣布全世界已经有超过 25 亿活跃安卓设备之后(2017 年是 20 亿),Android Q 进行了一次相对简单的更新。

Android Q 将更多地针对 OLED 屏幕和折叠屏手机进行优化。当用户在折叠屏手机外面的小屏上运行了一个 App 之后,打开手机,这个 App 会自动继续在里面的大屏上适应现实。此外,Android Q 也将针对 5G 进行优化适配。

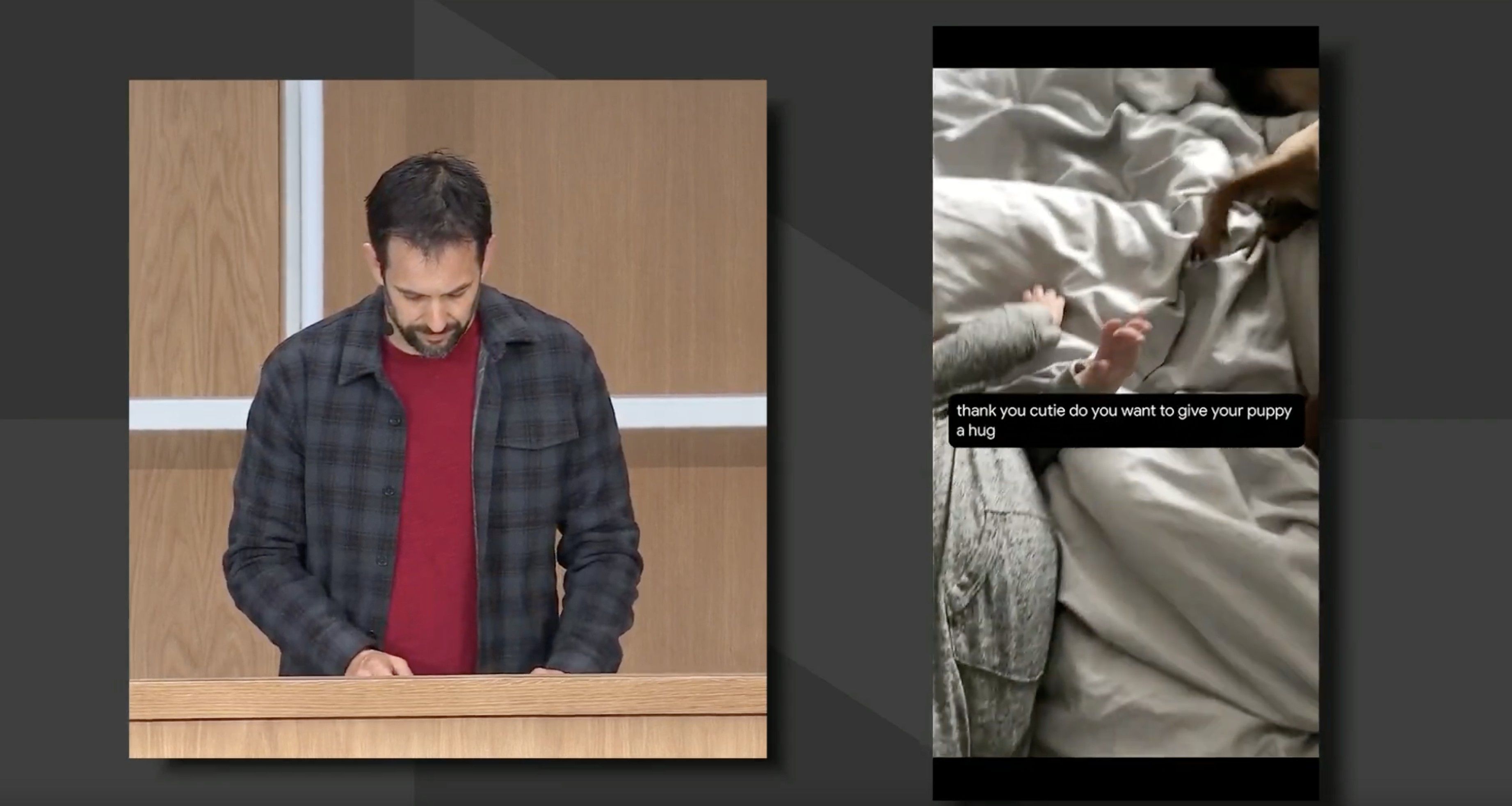

Android Q 将支持「实时字幕」功能,能识别手机发出声音中的语音,不需要联网就可以将它们转换成文字,显示在手机上。

实时字幕功能 | Google

实时字幕功能 | Google针对 IM 聊天软件,Android Q 还新加入了「智能回复」和「推荐操作」功能,可以针对不同消息给出回复建议,还可以识别消息中的特定信息,推荐后续操作。比如当别人发来的消息中有某个「地址」,Android Q 会自动给出「在地图中打开」的选项。这些功能支持所有的第三方 IM 聊天软件。Android Q 将很多深度学习和个性化功能放在了手机本地,不仅是为了保护用户隐私,也提高了处理和相应的速度。

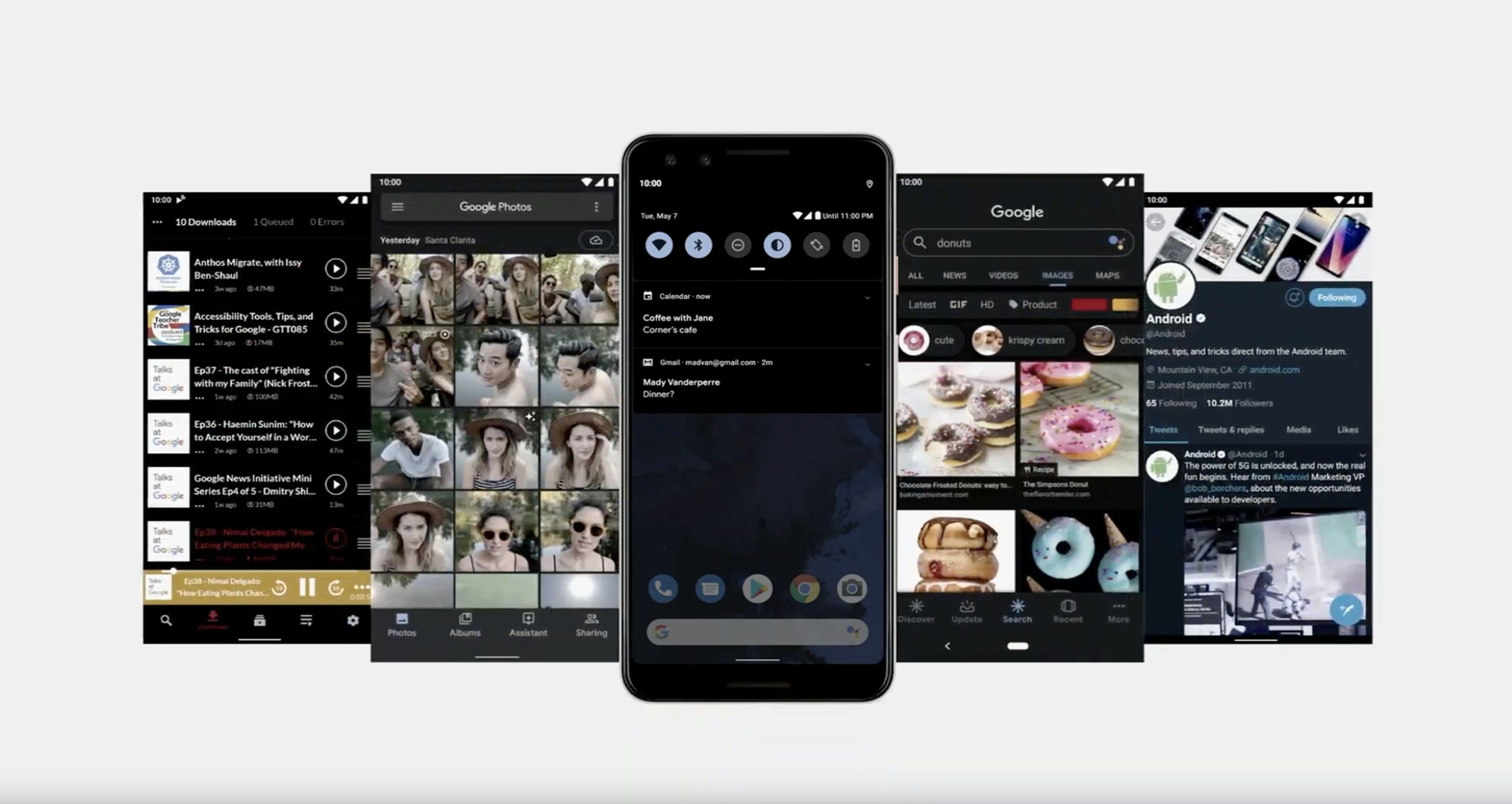

Android Q 还将加入「夜间模式」,让很多 App 的界面在暗光环境下可以变得更友好,也可以帮助 OLED 手机省电。

夜间模式 | Google

夜间模式 | Google除了功能更新之外,Android Q 第二个重点更新在于「安全和隐私」。

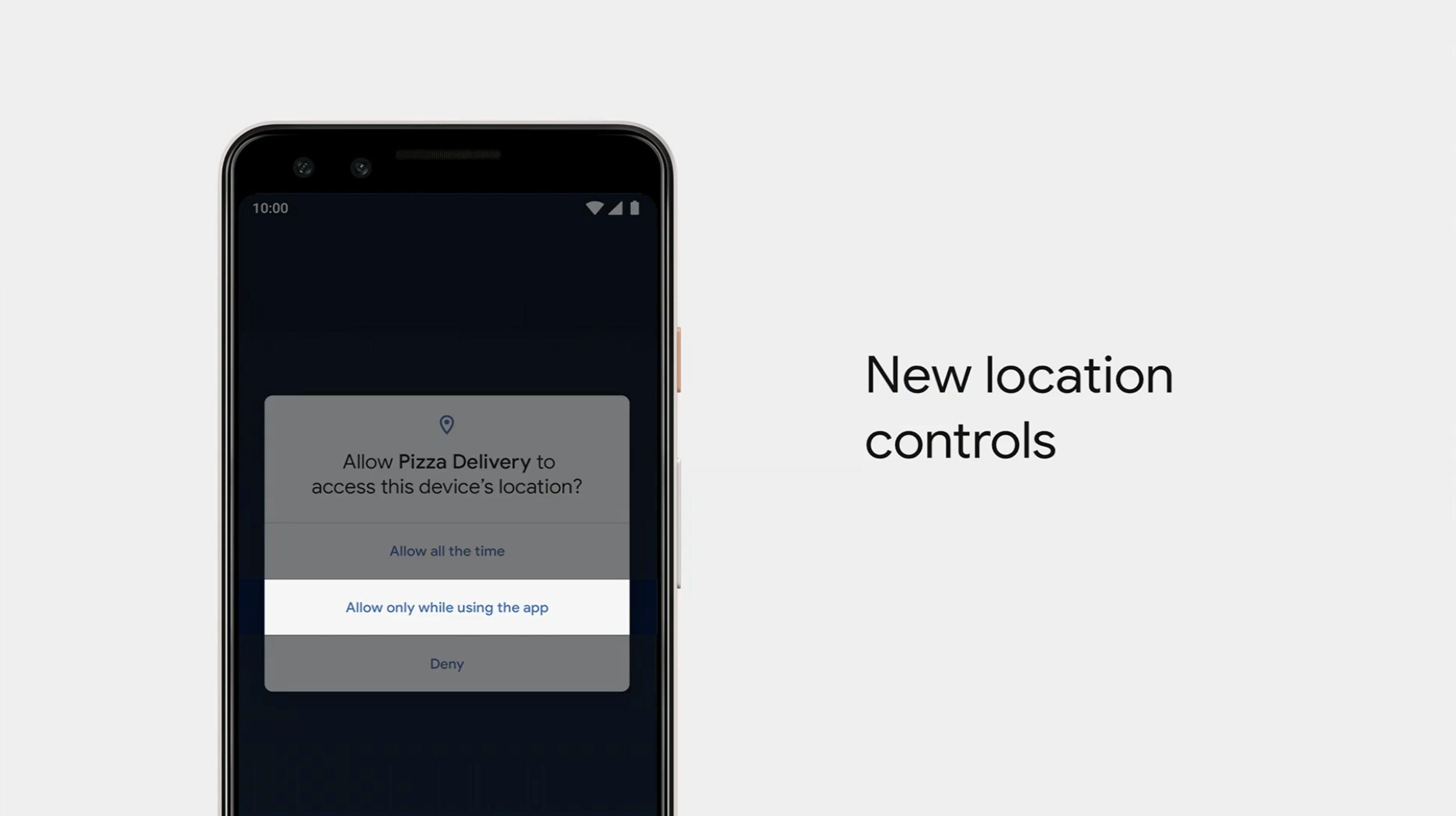

Android Q 将各种隐私选项集成进了一个设置菜单中。用户可以在设置-隐私中控制所有隐私相关选项,包括行为动态、位置记录和广告追踪设定。Android Q 会自动向用户提醒有 App 一直在记录位置,用户将位置权限设置为「仅在使用 App 时允许获取」。

位置权限设置 | Google

位置权限设置 | GoogleAndroid Q 升级了各种加密算法,使很多加密功能能顺畅地运行在低端手机上。同时,Android Q 将「安全升级」从系统升级中独立出来,一切关乎安全和隐私的相关升级将可以像升级 App 一样独立升级,不需要升级大版本系统,不需要重启手机。

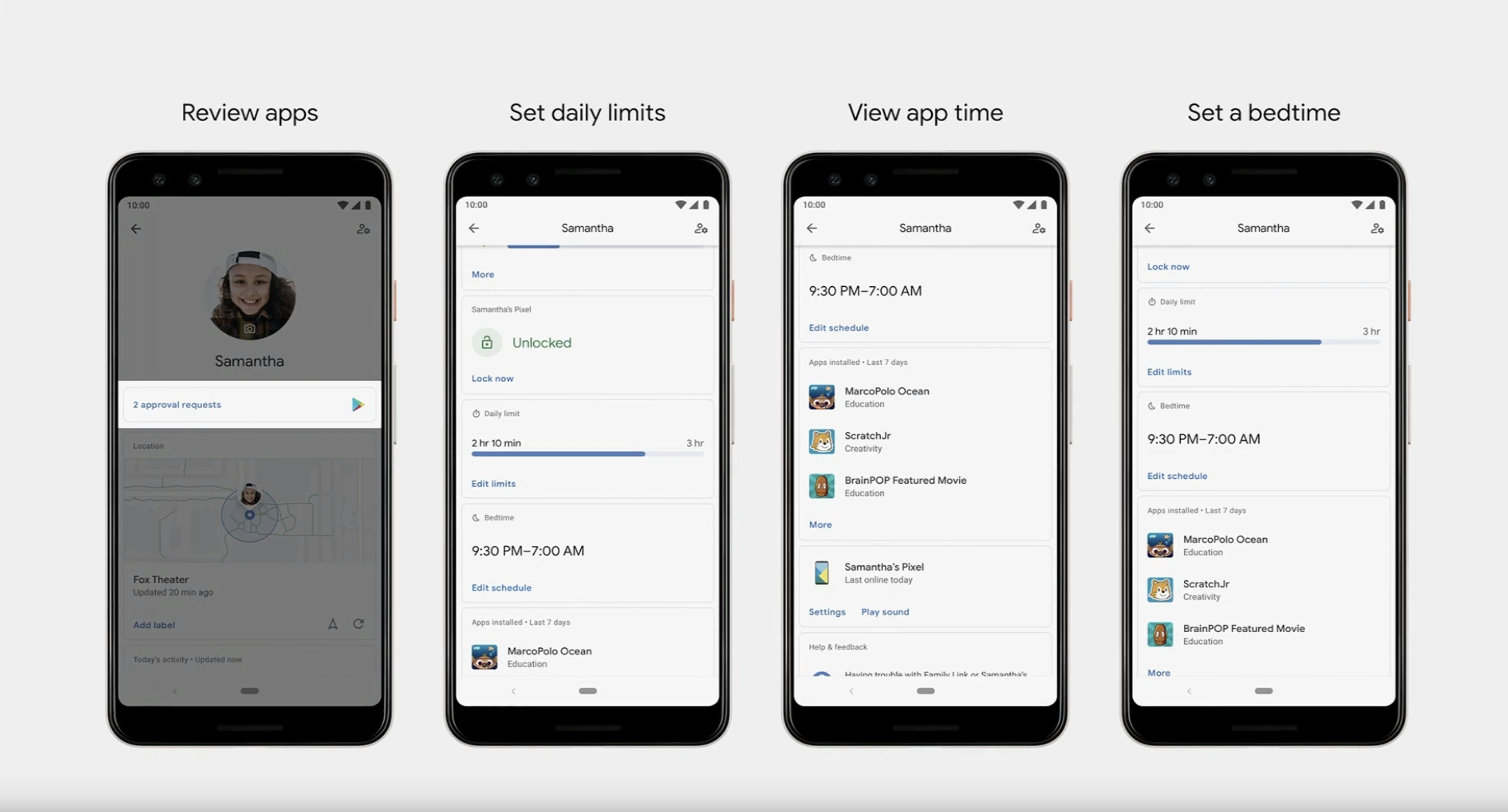

最后,Android Q 对监测用时用量的「Digital Well-being」功能进行了更新。帮助用户更好地了解自己使用手机的时常和强度,限制某些 App 的使用时间,在需要集中注意力的时候关闭手机的声音,在晚上睡觉的时候不被打扰。

Digital Well-being 功能 | Google

Digital Well-being 功能 | GoogleAndroid Q 新增了「集中注意模式」。用户可以设置一些容易让人分心的 App,比如短信、邮箱、YouTube。在进入「集中注意模式」之后,系统会限制这些 App 的使用和消息推送,帮助用户保持注意力集中。在退出「集中注意模式」后,一切被拦截的通知会重新显示。

Android Q 还在这一切控制手机使用功能的基础上加入了家长控制。现在,家长可以了解、控制自己小孩使用了哪些 App、用了多久,可以给小孩设定作息时间,也可以在到了时间限制后给他们稍微延长几分钟。

家长控制功能 | Google

家长控制功能 | Google包括一加、小米、OPPO、Vivo 在内的 12 家厂商的手机和所有 Pixel 手机会在第一时间收到 Android Q 的更新推送。

Pixel

定位中端市场的 Pixel 3a/Pixel 3a XL 如期而至。

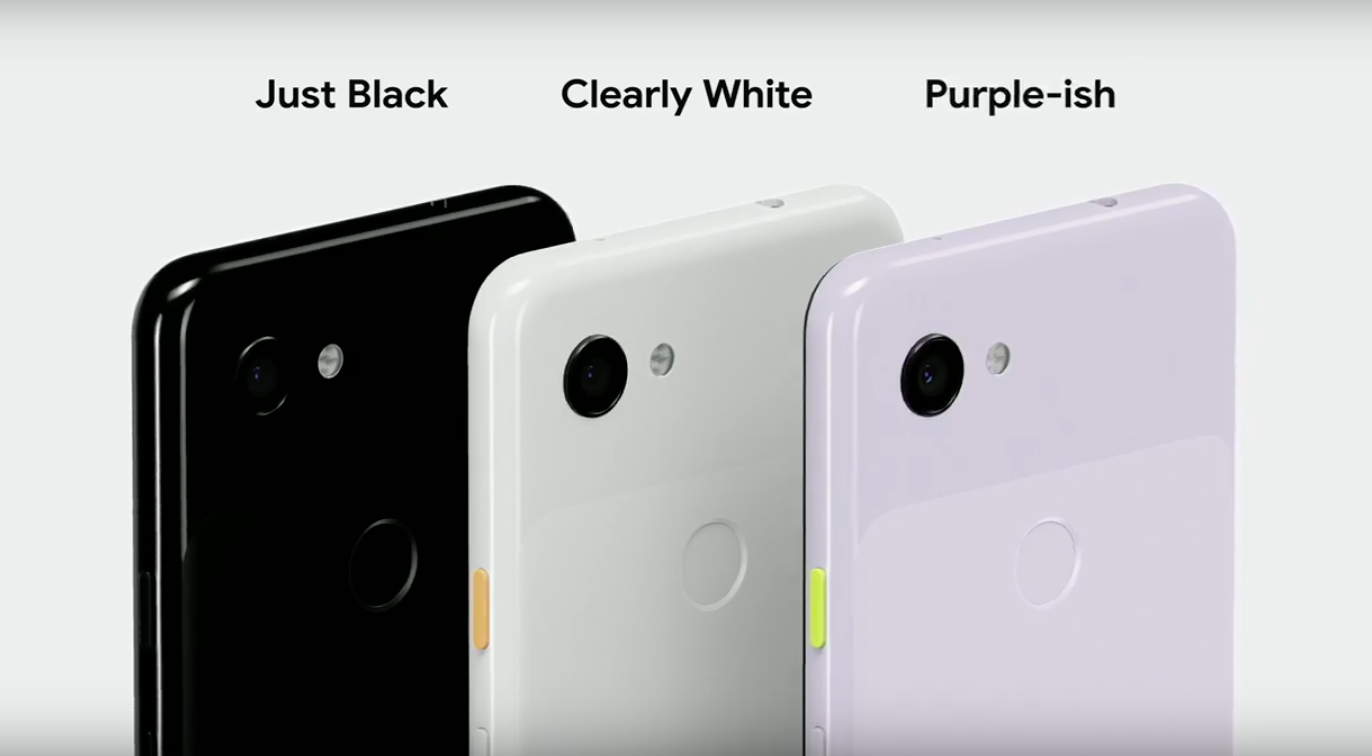

外观方面,Pixel 3a/Pixel 3a XL 延续了 Pixel 3 的外观设计,同时在黑白两色的基础上,新增了淡紫色(purple-ish)的款式。

三款配色 | Google

功能上,Pixel 3a/Pixel 3a XL 继承了上一代的诸多功能,比如 Active Edge 压感侧键、Titan M 安全芯片,支持 USB-C 接口等等。令人惊喜的是,在 Pixel 1 之后再也没出现过的 3.5mm 耳机孔又再次出现在了 Pixel 3a/Pixel 3a XL。

续航方面,Pixel 3a/Pixel 3a XL 分别搭载 3000mAh/3700mAh 电池,18W 快充。Google 表示一次充电可使用 30 小时,充电 15 分钟可使用 7 小时。

相机方面,没有双摄,没有三摄,祖传单摄,永远只有单摄。成本都拿来开发 AI,要啥摄像头。相机方面,Google 延续了「单摄不够,AI 来凑」的传统。Pixel 3a/Pixel 3a XL 采用 f/1.8 光圈 1220 万像素后置摄像头,f/2.0 光圈 800 万像素前置摄像头。在 Depth 景深模式和 Super Res Zoom 超级放大等 AI 功能的辅助下,Pixel 3a/Pixel 3a XL 保持着 Pixel 系列手机一贯高水平的拍照和摄像水准。

Pixel 3a 拍摄照片 | Google

尤其在暗光情况下,Pixel 3a/Pixel 3a XL 有着不俗的表现力,Google 甚至在宣传片中毫不隐晦地对比 iPhone X 的成像表现。从 Google 展示的成片来看,Pixel 3a/Pixel 3a XL 的暗光表现远超苹果两年前的旗舰机。

Pixel 3a 成像对比图 | Google

价格上,4GB+64GB 的 Pixel 3a/Pixel 3a XL 售价分别为 399 和 479 美元。发布会当天,Pixel 3a/Pixel 3a XL 在 Google Store 澳大利亚、加拿大、法国、德国等 13 个地区上架,Google 也将合作的运营商从 Verizon 扩展到了 Verizon、Sprint、U.S.Cellular 等 5 家运营商。

Pixel 3a | Google

虽然在发布过程中,无论是耳机孔的暗示还是赤裸裸的成像对比,Google 都有些针对苹果和 iPhone 的意思,但考虑到 Pixel 3a/Pixel 3a XL 中端手机的定位和售价,以及目前科技媒体和数码博主对这两款手机成像素质的高评价,即使是「不耻地」和两年前的前辈对比,Pixel 3a/Pixel 3a XL 依然有着很多可圈可点的地方。当然,高通骁龙 670 的处理器,注定了这两款「中端手机」无法满足很多对性能有需求的用户。

Google Assistant

去年,能够代替用户打电话的 Google Duplex 横空出世,震惊全场的同时也引发了不少争议。一年之后,Google 对 Duplex 进行了一次升级「再诠释」,将它从一个「能模拟真人对话」的语音 App 变成了一个专注于各种「流程自动化」的助手,进一步融入 Google Assistant 之中。

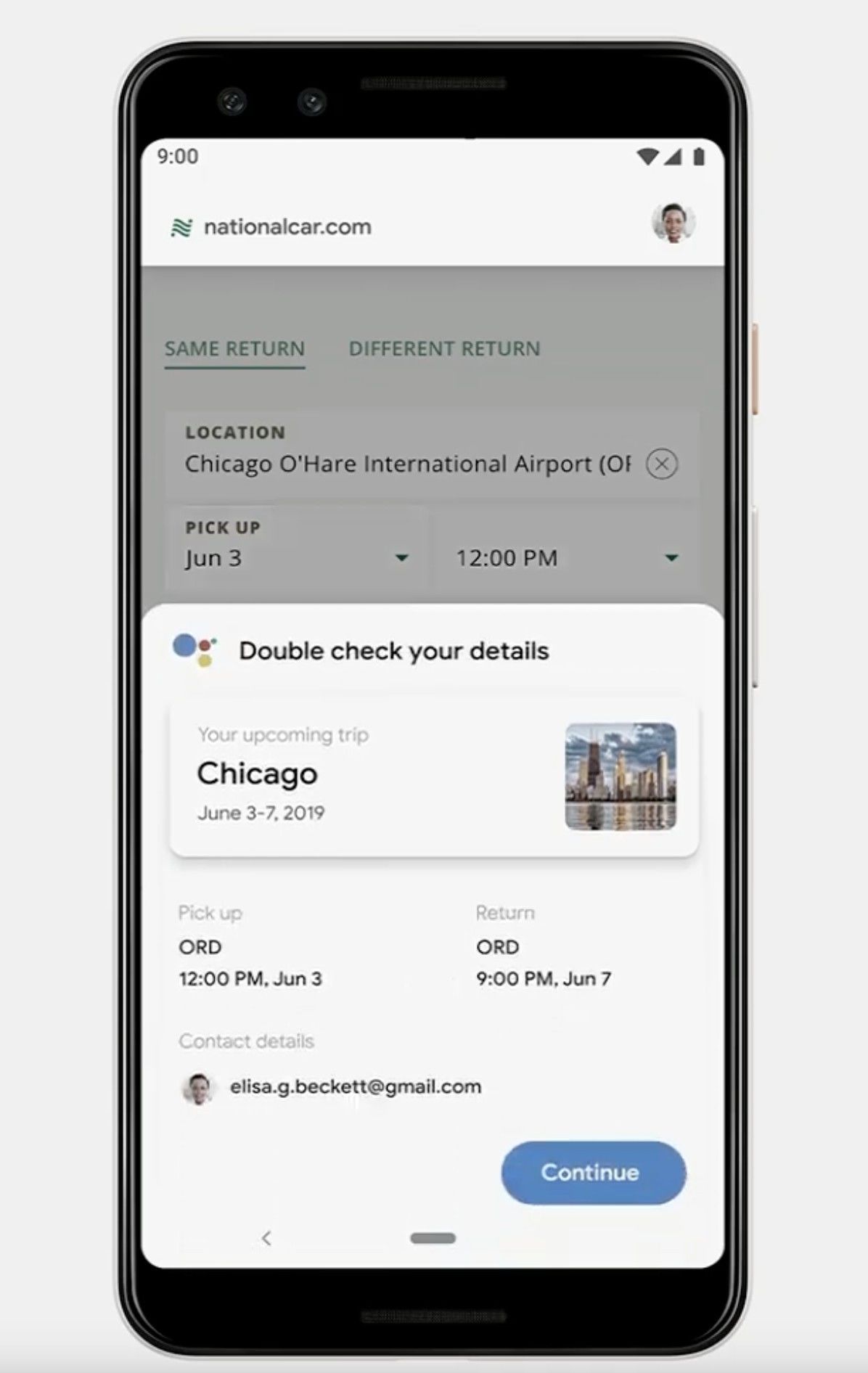

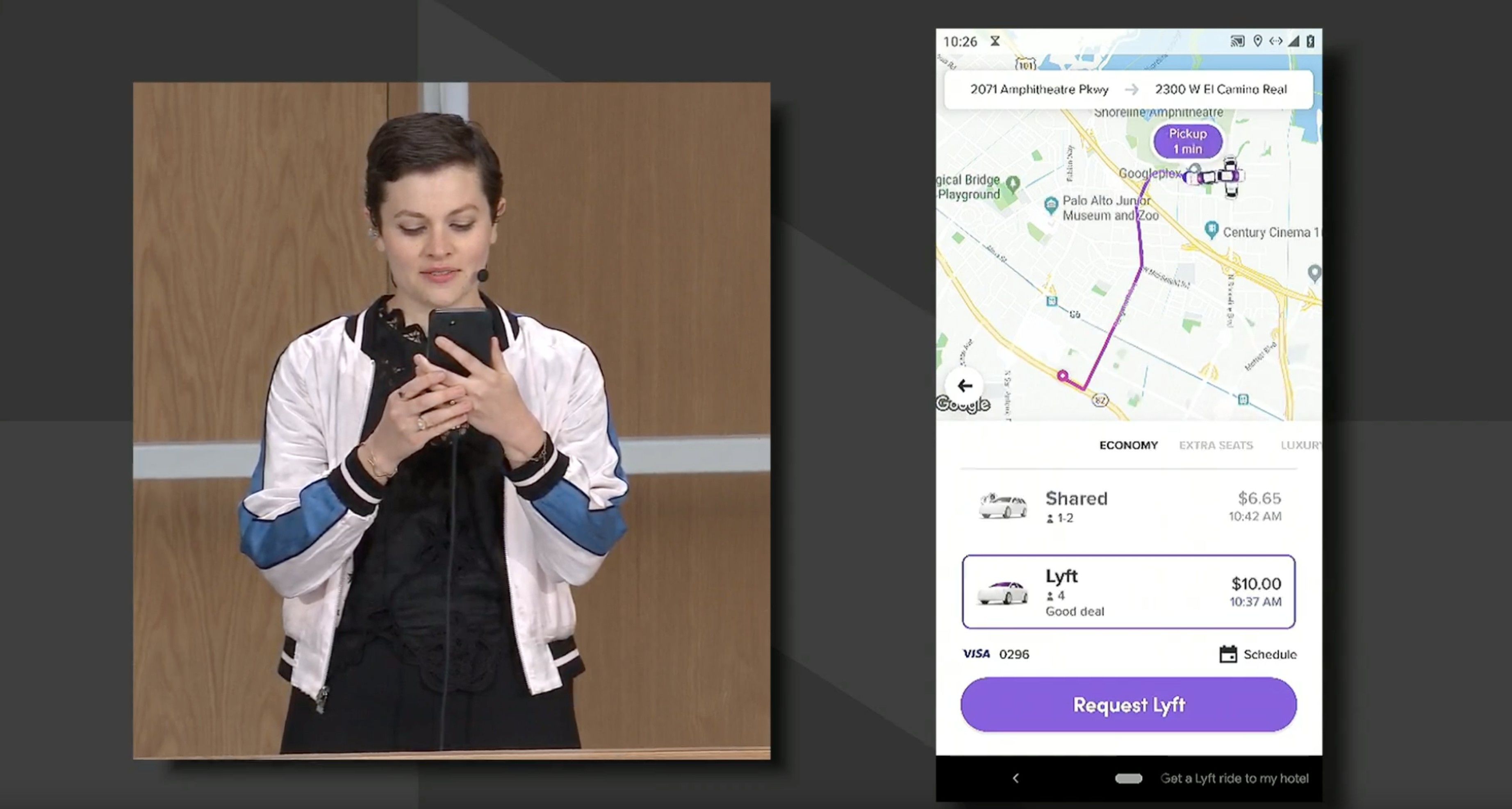

Duplex for Web 现在可以帮助用户快速填写复杂的表单,比如租车的相关信息。Google Assistant 会从用户的 Gmail、日历中读取信息,分析行程,预测用户的租车时间、地点,并且根据历史记录推荐用户可能喜欢的车型。Google 还联合租车公司对相关界面进行了优化,使信息呈现更简洁、直观。

Google Assistant 语音引擎的性能也变得更强了。借助深度学习技术,Google 把原本跑在云端,大小在 100G 左右的语音识别模型缩小到了 0.5G,使其可以运行在手机本地。用户不再需要一直说「Hey, Google」来唤醒 Assistant,只需要一次唤醒,Assistant 会自动保持活跃一段时间,聆听用户接下来的指令。

紧接着的演示中,工作人员在只用语音控制的情况下,连续展示了各种复杂操作:打开 App;调用天气、计时器等系统功能;进行打车、看特定 Twitter 等第三方 App 操作;回复短信并发送某张图片;创建并发送邮件。

得益于本地语音识别更快的速度,Google Assistant 可以进行更多操作、多任务处理、以及内容编写。今年晚些时候将发布的新款旗舰 Pixel 手机会搭载「本地识别」功能。

演示下一代 Google Assistant | Google

演示下一代 Google Assistant | Google除了性能变强之外,Google Assistant 也变得更「懂你」了,它会基于历史记录对语义库进行个性化的优化。比如当用户询问「去母亲家的路上堵吗?」的时候,Assistant 会调出你「母亲家」的具体地址,而不是搜索「母亲家」这个关键词。

除此之外,Google Assistant 还会针对同一问题给出个性化的答案。比如用户问有什么菜谱推荐时,它会基于用户之前的喜好推荐一些菜。目前 Google Assistant 能够做到个性化推荐的领域包括菜谱、播客和体育比赛。

最后,Google Assistant 新增了「驾驶模式」功能。将「为你推荐」、「最近去过的地点」、「联系人」和「多媒体」等用户常用的功能整合进了一个界面中。用户在驾驶导航的过程中和手机进行的一切交互都只会在小半部分的屏幕底部显示,不会干扰到主要的导航界面。

驾驶模式 | Google

驾驶模式 | Google智能音箱 Nest

当所有人还在期待 Google Home 的更新时,Google 先丢下了一颗关于品牌战略的重磅炸弹,宣布从今往后,Google 所有的智能家居都将被冠以 Nest 的品牌。这一智能家居品牌在被收购 5 年之后,成为了 Google 智能家居的唯一品牌。

Nest Hub Max | Google

Nest Hub Max | GoogleGoogle 发布了 Nest Hub Max,是之前带屏智能音箱 Google Home Hub 的升级版。Nest Hub Max 为「公共空间」量身打造,有着更大的 10 英寸屏幕和摄像头,能控制所有支持 thread 协议的智能家居,也可以播放 YouTube TV 的电视直播。

既然是为「公共空间」打造,Hub Max 不仅具有声纹识别功能,还能进行人脸识别。它会对用户进行识别,提供一整套个性化的体验。包括你的个人数据和内容偏好。除了声音之外,用户也可以通过手势来控制它。比如在来电话时,只需要朝着它抬起手,它就会自动暂停音乐。

Hub Max 会提供个性化的体验 | Google

Hub Max 会提供个性化的体验 | GoogleHub Max 可以作为「安防摄像头」使用。用户可以通过它远程查看家里的情况,它还具有「动作检测」功能,在检测到家里有「陌生运动物体」时会给用户推送通知。配合通话软件 Google Duo,Hub Max 可以进行视频通话,并且可以在通话过程中实现自动追焦功能。

配合 Google Duo 进行追焦通话 | Google

配合 Google Duo 进行追焦通话 | Google为了保护用户的隐私,Hub Max 配备了一个运行指示灯。当摄像头处于工作状态时,旁边的一个小绿灯会亮起,用户也可以通过它背后的一个实体开关手动开关摄像头以及麦克风。它们开闭的状态也会直观地显示在屏幕上。

Hub Max 定价 229 美元,今年夏天在美国、英国和澳大利亚上市,之前的 Nest Hub 降价至 129 美元,将在 12 个新国家上市,支持 9 种新语言。

隐私安全

当探讨如何建立一个更有帮助的 Google 时,安全和隐私就成为了一个绕不开的话题。Pichai 表示当人们在发展人工智能时,所建立的人工智能模式是否起作用,如何确保人工智能不强加偏见,如何提高机器学习的透明度,成为了至关重要的问题。为了解决机器学习中的偏见,Google 推出并且开放了叫做 TCAV 的新研究方法,之后将发布更多工具和数据集。

Google 更新了 Google Account,将隐私设置集合在 Google Account 之下,同时用户可以选择数据被保存的时间。Chrome、YouTube、Google Maps 将新增 Incognito mode(隐身模式),比如在 Google Maps 中,用户搜索过或者导航过的地点不会与账号相连。

皮查伊在台上介绍了机器学习方法「联合学习」(federated learning),可以在手机设备上直接训练 AI 模型,不用把数据上传到云上,保证数据的安全。比如应用到 Gboard 上,这项技术可以帮助用户预测表情包和对话。

无障碍功能

人文关怀成为了这一次 Google I/O 开场演讲的重点之一,其中,多款无障碍功能的发布也成为收获掌声最多的一个环节。前不久,Google 发布了一款应用 Live Transcribe,运用语音识别技术将实时对话转录称屏幕上可阅读的文本,目前已经支持超过 70 中语言和方言。而在 I/O 发布会上,Google 给我们带来了更多的成果。

Live Transcribe | Google

Live Caption 是一款视频和音频被实时转录成文字的工具,它能够覆盖在用户使用的任何应用上,比如 YouTube、Instagram,或者视频聊天应用上。它能够分析源音频,即便在音量调成静音的情况下,Live Caption 也能够正常工作。

Live Caption | Google

Live Relay 通过语音识别和文本语音转换来帮助聋哑人进行电话交谈。Live Relay 利用了 Smart Compose 和 Smart Reply 功能,预测性回复建议和及时反映能够帮助打字者跟上语音通话的速度。

Live Relay | Google

Project Euphonia 是 AI for Social Good 项目的一部分,团队与非盈利组织 ALS TDL 和 ALSRI 一起记录 ALS(肌萎缩侧索硬化)患者的声音。Google Assistant 是为大多数语言功能正常者提供的服务,并不适用于有语言障碍的少数群体。为了解决这个问题,Google 在全世界各地收集语言障碍者的声音样本,弥补有限的训练数据所造成的人工智能偏差问题,Google 希望通过收集这些数据来改进算法,最终整合到 Google Assistant 中。

Project Euphonia 项目 | Google

纵观整场发布会,除了各种令人兴奋的良心产品和酷到没朋友的 AI 应用以外,谷歌多少有些刻意强调的东西。

比如本地处理(on-device)的 AI 任务,这本是苹果发布会上谈起机器学习最常说的词,如今大环境对隐私信息越来越敏感,Google 也不得不频繁强调用户使用他们产品时的信息安全问题了。

还有人情味十足的产品宣传视频,Google Lens 加入的语音翻译功能就是一个例子。大会上皮查伊播放了一个印度女性的视频,讲述了这名没接受过教育,不识字的女性如何通过 Google Lens 拍照翻译和朗读的功能方便生活的故事。

除了 Google Lens 以外,上述几款无障碍功能也展示了各自的真实应用案例。对在场很多人来说,这样的技术展示视频是非常少见的。甚至在现场情绪的渲染中,极客公园创始人张鹏也忍不住感慨这些温馨和感动让他有些不适应,这是他第四次参加 Google I/O 大会,但这次是他认为「最政治正确」的一次,「核心体现出了对科技改变力进行的边界收敛和重新聚焦」,某种程度上,也是硅谷科技圈近年来越发倾向保守主义的体现。

但这并不是什么坏事,Google 在一场紧凑的发布会中持续证明了科技在表现「酷」的同时,也能够切实对每个人的真实生活有所助益。让世界变得更平,让每个人变得更好。这也是 Google 所强调的「Helpful」的真意所在。

图片来源:Google

责任编辑:宋德胜